Vos études montrent que certains acteurs instrumentalisent les réseaux sociaux pour gagner de l’influence. La foule numérique est-elle facilement manipulable ?

Il existe plusieurs leviers de manipulation. Le premier, c’est l’influence des plateformes numériques : Facebook ou X déploient à la fois un design d’infrastructure et des algorithmes de recommandation qui leur permettent d’orienter les foules dans certaines directions, soit d’opinion, soit d’attitude. Leur premier objectif est de vendre de la publicité ou des biens, mais leurs services peuvent facilement être détournés pour vendre des opinions. Lors des dernières élections législatives, de la publicité politique ciblée financée par le Kremlin a ainsi inondé Facebook pour influencer les Français. Cela est possible parce que ces infrastructures savent tout de leurs utilisateurs, dont ils aspirent les données.

Le second levier est la personnalisation des contenus grâce à un algorithme de recommandation biaisé et conçu pour maximiser leurs profits. Il amplifie par exemple la diffusion des contenus dit “toxiques “ (insultes, attaques personnelles, etc.), déformant la perception de la réalité de chacun dans un sens qui n’est compatible ni avec le bien-être individuel, ni avec un débat public sain.

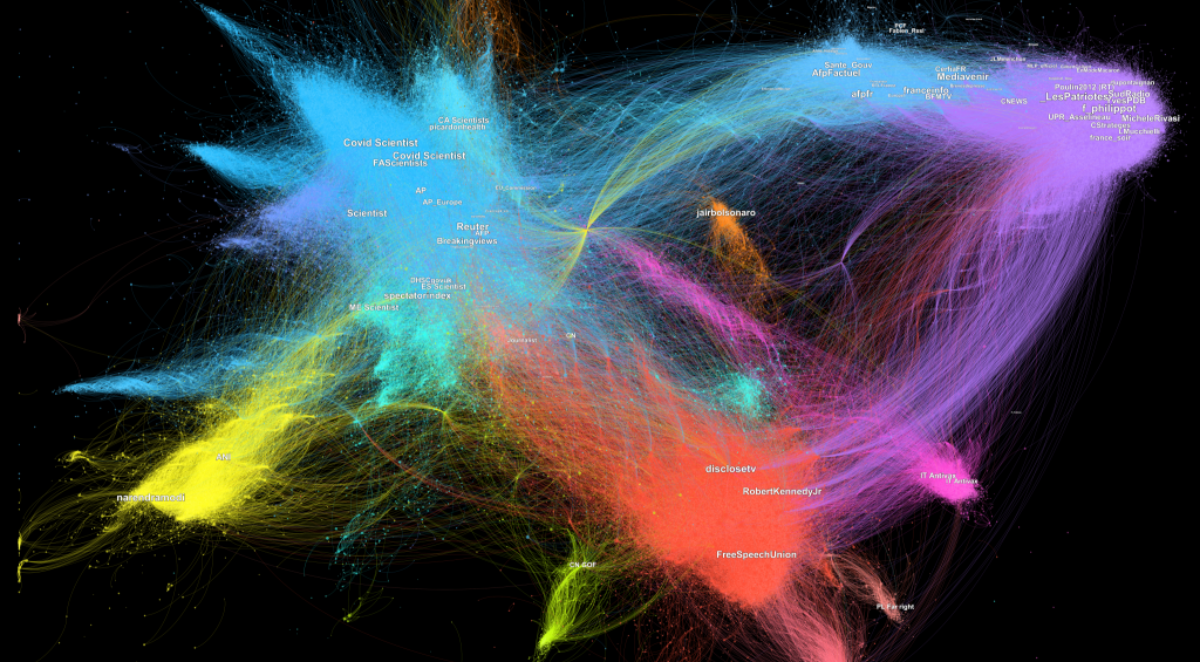

Enfin, les plateformes sont manipulées malgré elles, via par exemple l’utilisation d’armées de faux comptes (bots). Ces derniers diffusent de la désinformation ou des discours antisystème en donnant l’illusion qu’une foule, en réalité factice, y adhère. Mise en œuvre à grande échelle, cette technique peut tromper les utilisateurs, mais aussi les algorithmes de recommandation des plateformes qui les mettent alors en avant.

Vos travaux ont alerté sur le poids de ces pratiques. Comment expliquer leurs effets nocifs sur nos sociétés ?

Il y a deux catégories d’effets nocifs. On peut espérer que les dysfonctionnements des algorithmes de recommandation sont des effets secondaires non intentionnels du modèle économique des plateformes. Leur objectif de maximisation des profits les amène à optimiser l’engagement (le taux de partage, de likes et de commentaires). On a pu montrer que ceci se traduit mécaniquement par une amplification des contenus toxiques. Il n’y a pas d’intention de nuire, uniquement une absence d’éthique.

Les espaces numériques sont aussi devenus un terrain de guerre hybride au niveau géopolitique, et là, les interventions des acteurs sont clairement malveillantes. Dans ce cas, les plateformes ne les contrent pas car elles génèrent des profits (ex. vente de publicité, création artificielle d’activité), ou échouent à les contrer car une action efficace serait trop coûteuse.

Malgré les alertes qui se multiplient, ce phénomène ne cesse de progresser. Jusqu’où cela peut-il mener nos sociétés ?

Jusqu’à la fin de la démocratie. C’est déjà ce qui est en train de se produire aux États-Unis. Bien sûr, sur le très long terme, toutes les nations vivent des alternances de régimes plus ou moins autoritaires. Mais si vous ajoutez à cela la capacité pour certains acteurs de forcer le trait en amplifiant les divisions, cela rend les démocraties totalement instables. Les algorithmes de recommandation nous enferment et nous relient malgré nous à des acteurs qui peuvent nous faire penser que la réalité n’est pas ce qu’elle est.

Qu’est-ce que le Politoscope ? Est-il un antidote à ce poison ?

J’ai lancé cet outil avec des collègues de l’ ISC-PIF pour faire prendre conscience aux citoyens de l’emprise des GAFAM sur leur vie privée. Avec vos traces numériques, il est possible de reconstituer facilement toutes les opinions politiques des personnes d’un pays, les orientations sexuelles ou les croyances religieuses. L’objectif était aussi de donner aux personnes noyées dans ces foules numériques une vision en surplomb. Nous nous efforçons également de détecter les opérations d’influence, car les rendre publiques, c’est en atténuer la portée. Nous en avons mis en lumière plusieurs : l’une en 2017 qui a échoué mais visait à faire gagner Marine Le Pen, d’autres durant les dernières législatives et européennes qui allaient dans le même sens.

Cela pose la question de la régulation. Est-ce possible ?

Comme je l’ai écrit dans Toxic data*, il faut agir au niveau individuel, collectif et institutionnel. Sans être exhaustif, je citerais l’éducation aux médias, car le pouvoir des plateformes ne s’appuie que sur le fait qu’on les nourrit de nos actions et données. Au niveau collectif, il y a évidemment la régulation et la pénalisation de certains comportements abusifs des GAFAM et la nécessité de construire des communs numériques en encourageant les plateformes alternatives, sans oublier la question de l’utilisation des données. D’un point de vue institutionnel, il faut mener une réflexion sur la vulnérabilité des institutions aux manipulations numériques. Il existe de nombreuses solutions que l’on peut implémenter rapidement et à faible coût. Il est assez irresponsable qu’elles ne soient pas déjà mises en place par la puissance publique.